L’essor de l’IA touche la sphère éthique. La technologie évolue avec une vitesse surprenante. Les experts observent que les contraintes s’imposent malgré une avancée exponentielle.

La réflexion sur l’utilisation responsable apparaît désormais comme un impératif. Cet article présente l’état actuel, les retours d’expériences et les perspectives pour 2025.

A retenir :

- Importance d’une éthique rigoureuse dans l’IA

- Contraintes computationnelles et biais persistants

- Cadres législatifs en évolution

- Opportunités de collaboration internationale

Les défis éthiques de l’IA en 2025

Les systèmes actuels peinent à appréhender le contexte global. Ils nécessitent encore beaucoup d’apprentissage pour saisir certaines nuances culturelles.

Les modèles fonctionnent avec d’importantes quantités de données. Les biais persistent malgré des efforts notables.

Limites computationnelles et contextuelles

Les systèmes montrent des limites dans la compréhension des subtilités. La traduction automatique et l’interprétation de métaphores restent des défis.

- Collecte massive de données sensibles

- Incapacité à saisir la complexité culturelle

- Modèles axés sur la quantification

- Nécessité d’un encadrement éthique

| Aspect | Observation | Impact en 2025 |

|---|---|---|

| Compréhension contextuelle | Limites dans la saisie des nuances | Risque d’erreurs d’interprétation |

| Dépendance aux données | Enorme volume requis | Complexité de généralisation |

| Biais algorithmiques | Non-neutralité persistante | Résultats discordants |

Données et biais algorithmiques

La dépendance aux données entraîne un renforcement des biais préexistants. Les analyses montrent que des résultats discriminatoires peuvent se produire.

- Impact sur la responsabilité algorithmique

- Exigence pour la transparence des modèles

- Constat dans plusieurs secteurs

- Besoin d’audits externes réguliers

| Critère | Pourcentage observé | Commentaire |

|---|---|---|

| Données biaisées | 60% | Présence notable dans les systèmes |

| Interventions éthiques | 75% | Stratégies en renforcement |

| Surveillance algorithmique | 45% | Nécessite davantage de contrôle |

La complexité des modèles invite à une vigilance accrue.

Règlementations et normes de l’IA éthique en 2025

La réglementation se durcit pour encadrer l’usage des intelligences artificielles. Plusieurs États adoptent des lois strictes sur la transparence et la protection des données.

De nombreux organismes internationaux proposent des cadres éthiques. Ces normes favorisent le reportage et la responsabilité algorithmiques.

Cadres législatifs émergents

Les États renforcent la loi concernant les systèmes d’IA. Les réformes visent à limiter les risques liés aux deepfakes et aux biais discriminatoires.

- Mise en place d’une gouvernance renforcée

- Surveillance des systèmes par des experts

- Évaluation régulière des algorithmes

- Formation aux enjeux juridiques

| Région | Initiative | Objectif |

|---|---|---|

| États-Unis | TRAIGA | Encadrement strict de l’IA |

| Union européenne | DORA | Protection et responsabilité |

| Colorado | Loi sur l’IA | Limiter l’usage des deepfakes |

Normes internationales et responsabilité

Les expert·e·s insistent sur la responsabilité entre partenaires. La collaboration entre l’industrie, les universités et les organismes règlementaires progresse.

- Mise en place de chartes éthiques

- Suivi des pratiques de transparence

- Initiatives collaboratives mondiales

- Soutien aux lanceurs d’alerte

| Critère | Responsable | Mesure de suivi |

|---|---|---|

| Transparence | Entreprises | Rapports annuels |

| Équité | Organismes internationaux | Audits réguliers |

| Responsabilité | Universités | Protocoles certifiés |

Cas pratiques et retours d’expérience sur l’éthique de l’IA

Les retours d’expérience confirment que l’IA éthique reste un chantier en évolution constant. Les professionnels rapportent des situations contrastées.

Des initiatives pionnières et des échecs marquants témoignent des enjeux sous-jacents. L’analyse progressive apporte des enseignements précieux.

Avis d’experts et témoignages

Des spécialistes évoquent des réussites notables en matière d’IA responsable. Dr Claire Martin partage son expérience lors d’un projet sur les algorithmes de santé.

« L’intégration de critères éthiques a transformé nos approches dans la recherche médicale. »

Dr Claire Martin

Un ingénieur de renom confirme un sentiment similaire sur un forum technologique.

« Le reportage transparent sur l’IA a renforcé la confiance dans nos systèmes. »

Jean-Pierre Leroy

- Retours concrets sur l’application des chartes éthiques

- Expériences révélant des biais corrigés

- Valorisation des audits externes

- Encouragement à la collaboration intersectorielle

| Projet | Approche | Résultat |

|---|---|---|

| Recherche médicale | Intégration éthique | Amélioration de la transparence |

| Recrutement IA | Test anti-biais | Réduction des discriminations |

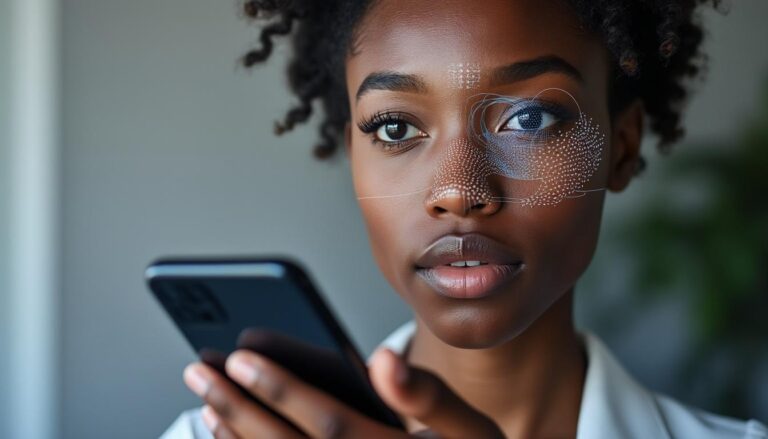

| Reconnaissance faciale | Audit réglementaire | Renforcement de la sécurité |

Exemples d’échecs et réussites

Microsoft a interrompu rapidement un projet suite à des dérives inattendues. L’expérience souligne l’importance du suivi continu.

Un projet de recrutement IA a connu des complications liées aux préjugés. Ces exemples nourrissent des débats constructifs sur la transparence des algorithmes.

- Expériences négatives corrigées par la supervision

- Initiatives positives valorisées par le secteur

- Investissements dans les audits de sécurité

- Adaptations rapides au retour d’expérience

| Cas | Défi rencontré | Leçon retenue |

|---|---|---|

| Chatbot Microsoft | Problèmes éthiques | Nécessité de la supervision humaine |

| Reconnaissance faciale | Violation de vie privée | Importance du consentement |

| Recrutement automatisé | Biais discriminatoire | Audit régulier requis |

Perspectives d’avenir pour une IA respectueuse

Les innovations futures viseront à conférer plus d’humanisme aux systèmes d’IA. Les chercheurs explorent des architectures plus nuancées.

Les acteurs doivent renforcer la collaboration pour intégrer des principes de responsabilité dans chaque algorithme. Les progrès permettent d’envisager une IA bien alignée sur des valeurs sociétales.

Innovations et défis réglementaires

Les équipes de recherche développent des solutions pour améliorer la compréhension contextuelle. Les avancées techniques se combinent aux normes règlementaires.

- Systèmes dotés d’un reporter éthique interne

- Amélioration de la transparence algorithmique

- Procédures de suivi en continu

- Investissements en recherche collaborative

| Innovation | Avantage attendu | Application concrète |

|---|---|---|

| Algorithmes adaptatifs | Meilleure contextualisation | Traduction et interprétation |

| Audit automatisé | Contrôle continu | Systèmes de surveillance dédiés |

| Plateformes collaboratives | Échange de bonnes pratiques | Projets intersectoriels |

Collaboration entre parties prenantes

Les entreprises, agences universitaires et régulateurs unissent leurs forces pour garantir la transparence des systèmes d’IA. Les partenariats se renforcent dans le but d’atteindre un équilibre durable.

- Implémentation de chartes communes

- Partages réguliers de retours d’expérience

- Forums de discussions dédiés

- Séminaires sur les pratiques responsables

| Type de partenariat | Acteurs impliqués | Résultat attendu |

|---|---|---|

| Institutions universitaires | Universités et centres de recherche | Audit éthique renforcé |

| Industrie technologique | Entreprises et startups | Meilleure transparence interne |

| Organismes régulateurs | Gouvernements et ONG | Mise en place de normes communes |

Un acteur du secteur témoigne : « L’alliance entre experts a permis d’établir des pratiques révolutionnaires dans la gestion des algorithmes. » Ce point de vue confirme la nécessité d’un engagement partagé.